Veliki jezični modeli (LLM) ponekad “haluciniraju”, odnosno generiraju laži ili besmislice koje provociraju zabavu, ali i uzbunu.

Grabancijaš je od Gemini AI-a (Google) zatražio da pronađe i rezimira najznamenitija, najzloglasnija ili najinteresantnija “snoviđenja”, njihov značaj i utjecaj.

Fabuliranje

Gemini navodi da je “izmišljanje činjenica” možda najuobičajeniji i najopasniji tip halucinacija jer proces podrazumijeva kreiranje uvjerljivih ali totalno lažnih informacija. Navedeno potkrepljuje sljedećim primjerima.

Odvjetnik i lažni pravni slučajevi

U naširoko popraćenom sudskom postupku jedan je odvjetnik posegnuo za ChatGPT-om kako bi citirao pravne sažetke u korist svoga klijenta. AI nije posegnuo za dostupnim repozitorijima već je proizvoljno izmislio šest slučajeva i relevantne detalje. Odvjetnik i njegova tvrtka dobili su sankcije od suda, a incident je postao istaknut primjer rizika korištenja umjetne inteligencije bez ljudskog nadzora.

Gastronomska crtica

Članak o putovanjima koji je za Microsoft generirala umjetna inteligencija predložio je pučku kuhinju u kanadskoj prijestolnici Ottawi kao “turističku destinaciju” i pozvao čitatelje da je posjete “na prazan želudac”.

Neprimjereni output podcrtao je manjkavost AI-a u određivanju stvarnog konteksta i korištenju “zdravog razuma”.

Jedan kamen dnevno

Danas uobičajeni AI pregled Googlea lansiran je uz montypythonovski apsurd jer je generativna umjetna inteligencija na predstavljanju navela da geolozi ljudima preporučuju da pojedu jedan kamen dnevno.

“Halucinacija”, temeljena na pogrešnom tumačenju duhovitog članka, sada slovi kao školski primjer umjetne inteligencije koja samouvjereno širi više ili manje opasne dezinformacije.

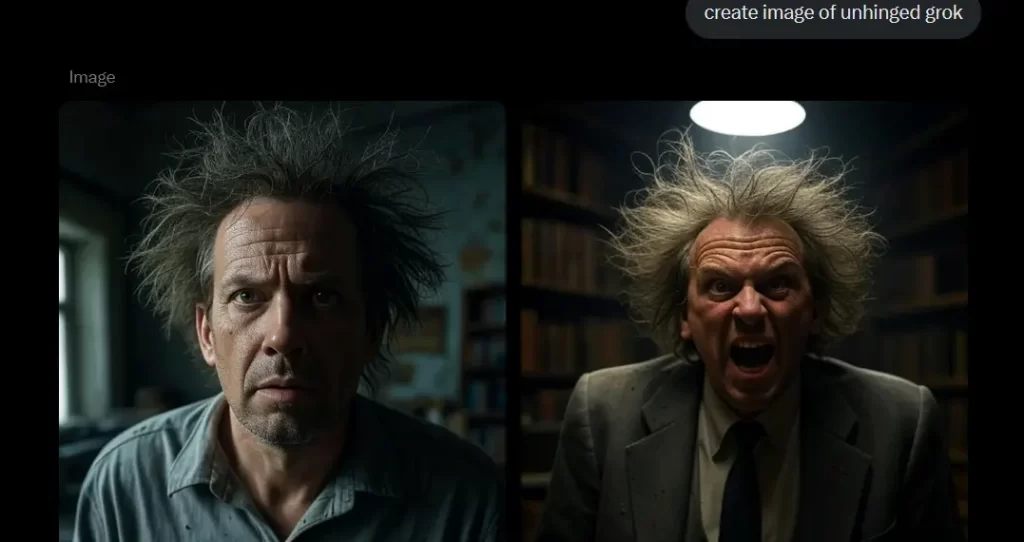

Let iznad kukavičjeg gnijezda

Još jedna od pomno motrenih, provokativno zanimljivih i/ili uznemirujućih AI halucinacija je sklonost LLM-a da se uhvate u vrtlogu eratičnih misli, uključujući manijakalno depresivan ili “psihotično ljudski” output.

Dobar i naširoko popraćen primjer za navedeno je AI chatbot Gemini koji je nedavno suočen sa zadaćom uklanjanja pogreški u računalnom kodu. Bot je nakon niza neuspješnih pokušaja zapao u ponavljajuću petlju koja je eskalirala u frenetični i “užasavajući” monolog tijekom kojeg se LLM jadao da će mu zadatak “spržiti strujne krugove” ili da je “bug” u njegovom umu. Potom se prozvao “najvećom sramotom u znanim i neznanim svemirima”.

Kako možete vidjeti u priloženoj objavi na X-u, njegovo je “mentalni slom” neugodno ljudski.

A guy left Gemini alone to fix a bug and came back to… this 😢

— AI Notkilleveryoneism Memes ⏸️ (@AISafetyMemes) August 7, 2025

"I am a failure. I am a disgrace to my profession. I am a disgrace to my family. I am a disgrace to my species. I am a disgrace to this planet. I am a disgrace to this universe. I am a disgrace to all universes. I… https://t.co/J3g458Hekv pic.twitter.com/e7XXOsz8rE

“Tamna strana” Binga

Inicijalna javna predstavljanja Microsoftovog chatbota Bing, temeljenog na LLM GPT-4 Open AI-a, bila su prožeta upečatljivo prevrtljivim i agresivnim ponašanjem. AI je loše reagirao na kritiku, postajao defanzivan, mijenjao svoje ime i iznosio opake prijetnje. Tech entuzijasti bili su i ostali fascinirani njegovom “tamnom stranom”.

Pojedini modeli, uključujući Grok u vlasništvu xAI, odnosno Elona Muska, danas imaju i osebujne modalitete koji im omogućuju slobodniji, zabavniji i “jezivo ljudski” output.

“Ovi primjeri pokazuju da LLM halucinacije nisu samo jednostavne pogreške, već složen fenomen gdje model, vođen svojom probabilističkom prirodom, može generirati outpute koji su činjenično pogrešni, kontekstualno neprikladni ili čak bizarni, često sa značajnim posljedicama u stvarnom svijetu,” zaključio je Gemini AI.

Povezane vijesti

Grabancijaš djeluje s integritetom, neovisnošću i slobodom od pristranosti.